A/B-testning

Vad är A/B-testning?

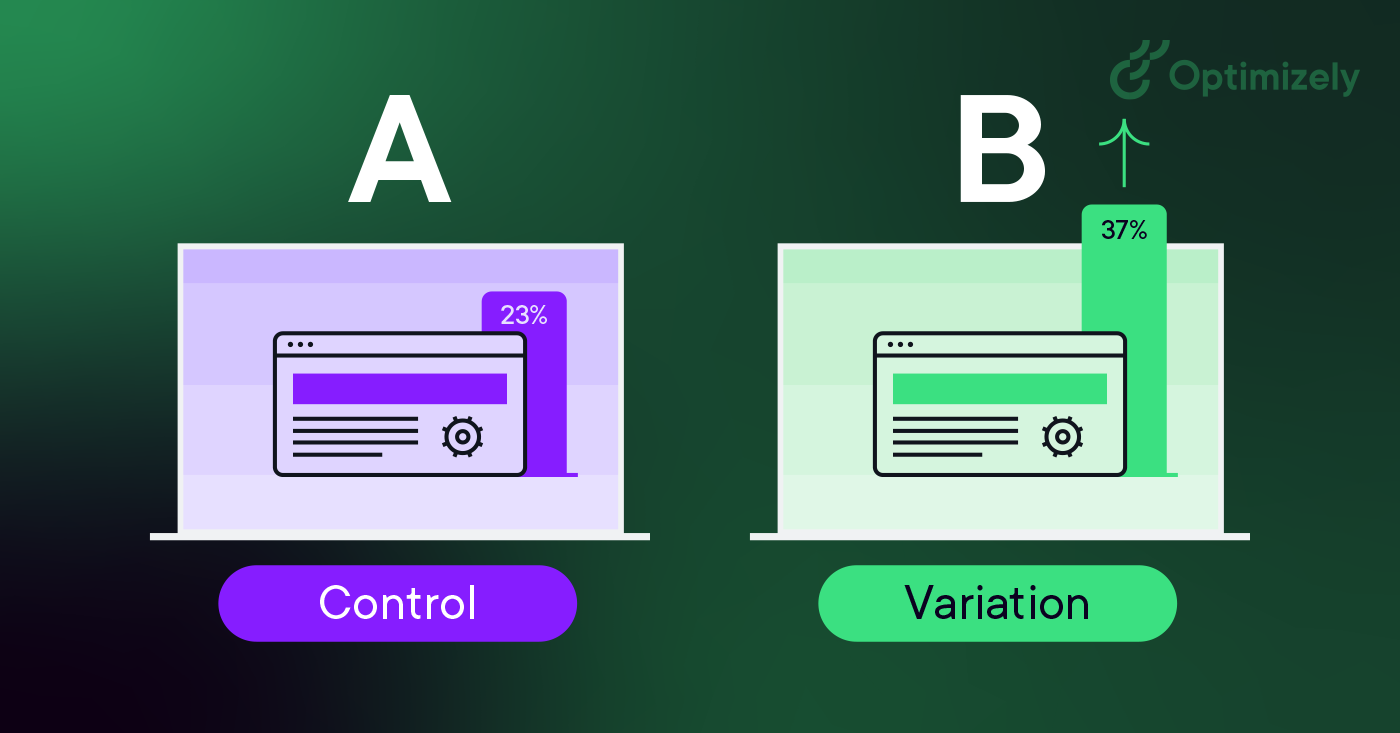

A/B-testning (även kallat split-testning eller bucket-testning) är en metod att jämföra två versioner av en webbsida eller app mot varandra och avgöra vilken som fungerar bäst. A/B-testning är som ett experiment där två eller fler varianter av en sida visas slumpmässigt för användarna, och statistisk analys används för att avgöra vilken variant som fungerar bäst för ett visst konverteringsmål.

Genom att köra ett A/B-test som jämför en variant med den nuvarande upplevelsen kan du experimentera med ändringar på webbplatsen eller appen och sedan samla in data om förändringens effekt.

Med testning slipper du förlita dig på gissningar och åsikter när du vill optimera din webbplats. Det möjliggör data-underbyggda beslut som flyttar diskussionen från ”vi tror att” till "vi vet att". Genom att mäta hur ändringar påverkar mätdata kan du säkerställa att varje förändring ger positiva resultat.

Så fungerar A/B-testning

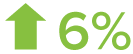

I ett A/B-test tar du en webbsida eller appskärm och ändrar den för att skapa en andra version av samma sida. Ändringen kan vara så enkel som en enda rubrik eller knapp, eller en helt ombyggd sida. För hälften av trafiken visas den ursprungliga versionen av sidan (kallad kontrollsidan) och för den andra hälften visas den modifierade versionen av sidan (varianten).

Medan besökare får se antingen kontrollsidan eller varianten mäts deras engagemang med vardera upplevelsen och samlas i en dashboard där den analyseras av en statistisk motor. Du kan sedan avgöra om förändringen av upplevelsen hade en positiv, negativ eller neutral effekt på besökarens beteende.

Varför man ska A/B-testa

A/B-testning gör det möjligt för individer, team och företag att göra små ändringar av användarupplevelsen och samla in data om resultaten. Det gör att de kan sätta upp hypoteser och lära sig hur vissa delar av upplevelsen påverkar användarbeteendet. De kan också bevisas ha fel – deras åsikt om den bästa upplevelsen för ett givet mål kan motbevisas genom ett A/B-test.

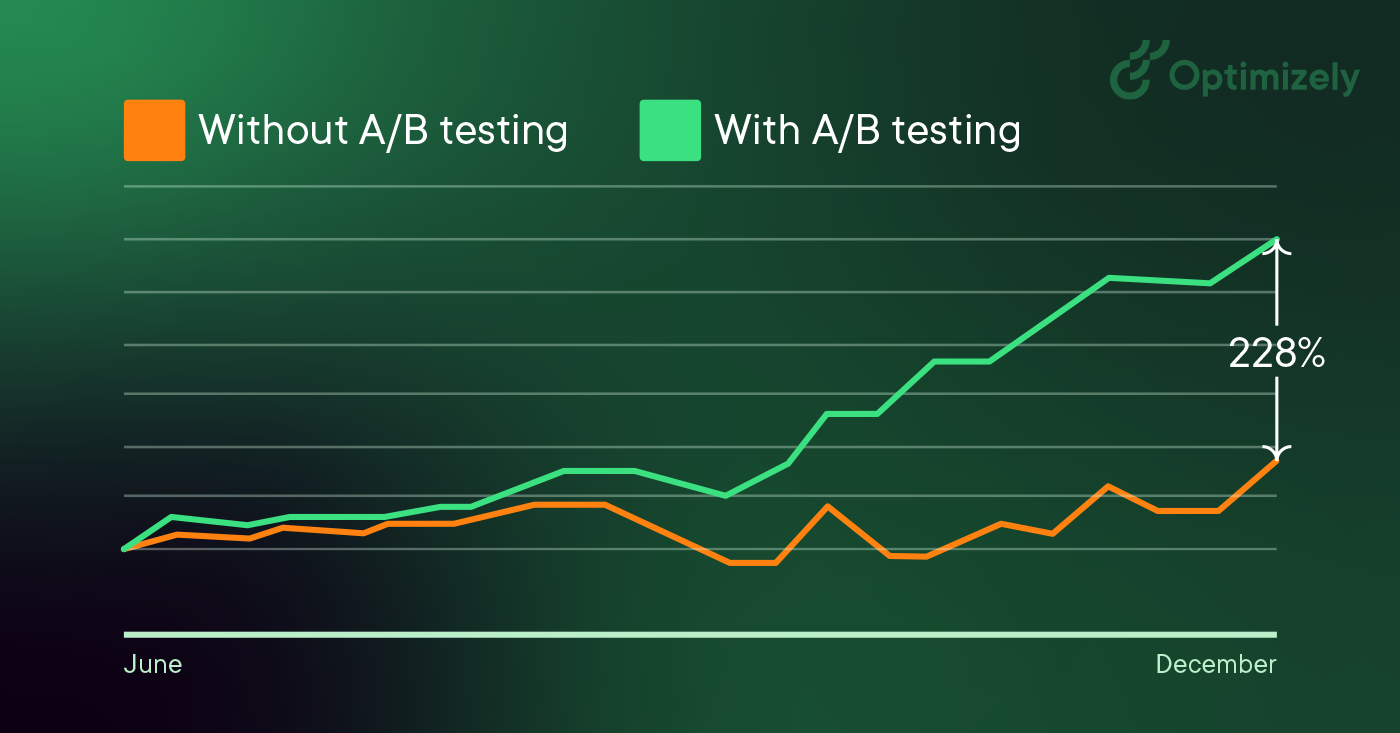

Utöver att bara svara på en enstaka fråga eller avgöra en tvist, kan A/B-testning användas för att kontinuerligt förbättra en given upplevelse eller förbättra ett enskilt mål över tid, som konverteringsgraden.

Ett B2B-teknikföretag kanske vill förbättra kvaliteten och volymen på leadsen från sina kampanjlandningssidor. För att uppnå målet skulle teamet kunna prova att A/B-testa förändringar av rubriker, visuella bilder, formulärfält, call to actions och sidans övergripande layout.

Genom att testa en förändring i taget kan de fastställa vilka förändringar som hade effekt på besökarnas beteende, och vilka som inte hade det. Över tid kan de kombinera effekten av flera vinnande förändringar från experimenten och påvisa en mätbar förbättring hos en ny upplevelse jämfört med den gamla.

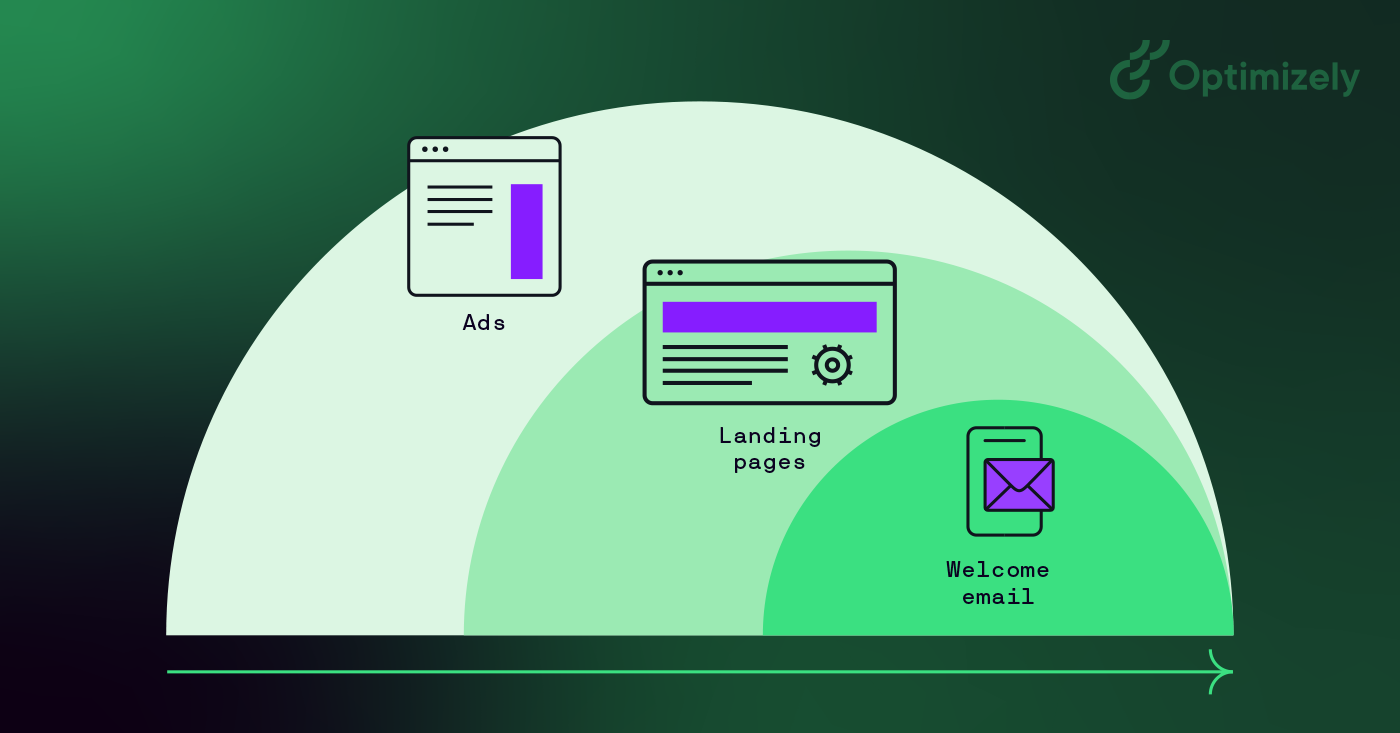

Den här metoden för att införa förändringar i en användarupplevelse gör det också möjligt att optimera upplevelsen mot ett önskat resultat, och det kan göra viktiga steg i en marknadsföringskampanj mer effektiva.

Genom att testa annonstexter ser marknadsförarna vilka versioner som får flest klick. Genom att testa landningssidan lär de sig vilken layout som bäst konverterar besökare till kunder. Totala kostnaden för en marknadsföringskampanj kan faktiskt minskas om detaljerna i varje steg fungerar så effektivt som möjligt för att skaffa nya kunder.

A/B-testning kan också användas av produktutvecklare och designers för att visa effekterna av nya funktioner eller förändringar av en användarupplevelse. Produktintroduktion, användarengagemang, modaler och produktupplevelser kan optimeras med A/B-testning, så länge som målen är tydligt definierade och du har en tydlig hypotes.

A/B-testprocessen

Följande är ett A/B-testramverk som du kan använda för att börja köra tester:

-

Samla in data: Ditt analysprogram ger ofta en inblick i var du kan börja optimeringen. Det hjälper dig att börja med områden med hög trafik på webbplatsen eller appen, så att du kan samla in data snabbare. Leta efter sidor med låg konverteringsgrad eller hög drop off som kan förbättras.

-

Identifiera mål: Dina konverteringsmål är de mätdata som du använder för att avgöra om en variant är mer framgångsrik än den ursprungliga versionen. Målen kan vara allt från klick på en knapp eller länk, till produktköp eller registrering av e-post.

-

Generera en hypotes: När du har identifierat ett mål kan du börja generera A/B-testidéer och hypoteser om varför du tror att de kommer att bli bättre än den nuvarande versionen. När du har en lista över idéer ska du prioritera dem i termer av förväntad inverkan och svårigheter med implementeringen.

-

Skapa varianter: Använd ditt A/B-testprogram (som Optimizely) för att göra önskade ändringar på en del av webbplatsen eller mobilappen. Det kan handla om att ändra färgen på en knapp, byta ordning på sidans element, dölja navigeringselement eller något helt annat. Många ledande A/B-testverktyg har en visuell redigerare som gör dessa ändringar enkla. Se till att kvalitetssäkra experimentet för att säkerställa att det fungerar som förväntat.

-

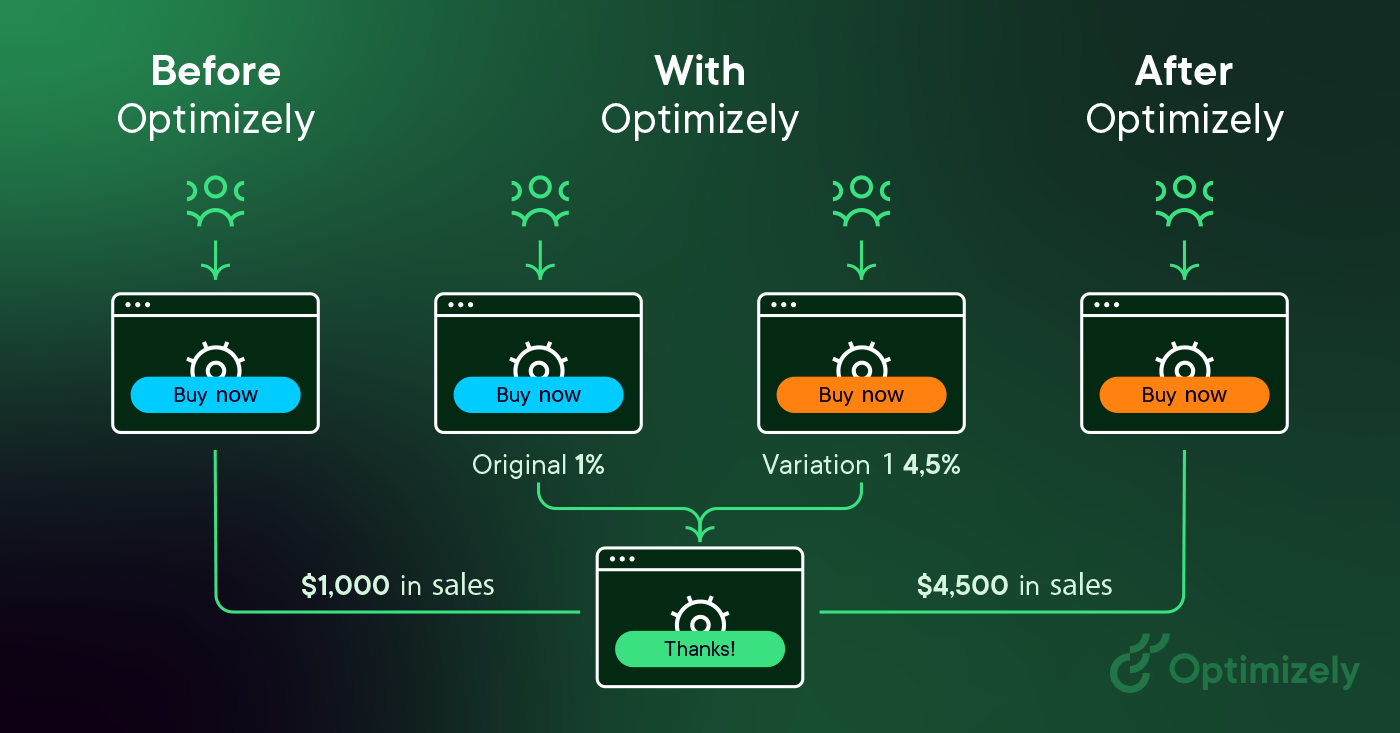

Kör experimentet: Rulla igång experimentet och vänta på att besökarna ska delta! Nu tilldelas besökarna på webbplatsen eller i appen slumpmässigt antingen kontrollsidan eller varianten av upplevelsen. Deras interaktion med varje upplevelse mäts, räknas och jämförs för att fastställa hur var och en presterar.

-

Analysera resultaten: När experimentet är klart är det dags att analysera resultaten. Ditt A/B-testprogram presenterar data från experimentet och visar skillnaden mellan hur de två versionerna av sidan har presterat och om det finns en statistiskt signifikant skillnad.

Grattis om din variant är en vinnare! Se om du kan tillämpa lärdomar från experimentet på andra sidor på webbplatsen och fortsätt upprepa experimentet för att förbättra resultaten. Om experimentet ger ett negativt resultat eller inget resultat alls ska du inte låta dig nedslås. Ta experimentet som en erfarenhet och generera en ny hypotes som du kan testa.

Oavsett resultatet av experimentet kan du använda erfarenheten för att skapa framtida tester. Upprepa kontinuerligt för att optimera upplevelsen av appen eller webbplatsen.

A/B-testning och SEO

Google tillåter och uppmuntrar A/B-testning och har uppgett att ett A/B- eller multivariattest inte utgör någon inneboende risk för webbplatsens sökrankning. Det är dock möjligt att äventyra sökrankningen genom att missbruka ett A/B-testverktyg för t.ex. cloaking. Google har uppgett en best practice för att säkerställa att så inte sker:

-

Ingen cloaking: Cloaking innebär att man visar ett annat innehåll för sökmotorer än vad en vanlig besökare ser. Cloaking kan leda till att webbplatsen rankas ner eller till och med tas bort från sökresultaten. För att undvika cloaking, missbruka inte besökarsegmentering för att visa Googlebot annat innehåll baserat på användaragent eller IP-adress.

-

Använd rel="canonical": Om du kör ett splittest med flera URL:er bör du använda attributet rel="canonical" för att peka varianterna tillbaka till den ursprungliga versionen av sidan. Det förhindrar att Googlebot blir förvirrad av flera versioner av samma sida.

-

Använd 302-redirects istället för 301: Om du kör ett test som omdirigerar den ursprungliga URL:en till en variant-URL, använd en 302 redirect (tillfällig) istället för en 301 redirect (permanent). Det talar om för sökmotorer som Google att omdirigeringen är tillfällig och att de ska behålla den ursprungliga URL:en indexerad snarare än test-URL:en.

-

Kör bara experimentet så länge som krävs: Att köra tester längre än nödvändigt, särskilt om du erbjuder en variant av sidan till en stor andel användare, kan ses som ett försök att lura sökmotorer. Google rekommenderar att du uppdaterar webbplatsen och tar bort alla testvarianter så snart ett test avslutas samt undviker att köra tester i onödan.

Ett medieföretag kanske vill öka läsupplevelsen, öka tiden som läsarna tillbringar på webbplatsen och stötta artiklarna med social delning. För att uppnå dessa mål kan de testa varianter på:

- Modaler för registrering av e-post

- Rekommenderat innehåll

- Knappar för social delning

Ett reseföretag kanske vill öka antalet genomförda bokningar på webbplatsen eller i mobilappen, eller öka intäkterna från merköp. För att förbättra dessa mätdata kan de testa varianter av:

- Sökmodaler för startsidan

- Sökresultatsidan

- Kompletterande produktpresentation

Ett e-handelsföretag kanske vill öka antalet genomförda köp, genomsnittligt ordervärde eller säsongsförsäljningen. För att uppnå detta kan de A/B-testa:

- Kampanjer på hemsidan

- Navigeringselement

- Delar i köpflödet

Ett teknikföretag kanske vill öka antalet högkvalitativa leads för sitt säljteam, öka antalet kostnadsfria testanvändare eller attrahera en viss typ av köpare. De kan testa:

- Komponenter i formuläret för leads

- Flödet för att få gratis testversioner

- Meddelanden och call-to-actions på hemsidan

Exempel på A/B-tester

Följande A/B-testexempel visar de typer av resultat som världens mest innovativa företag har sett genom A/B-testning med Optimizely:

Discovery A/B-testade komponenter i sin videospelare för interaktionen med sitt program ”Superfan”. Resultatet? En ökning av videoengagemanget med 6 %.